OpenAI

Нода отправляет запросы к API OpenAI (Chat Completions) для генерации текста. Поддерживает передачу истории диалога из воркфлоу, системный промпт и расширенные параметры генерации.

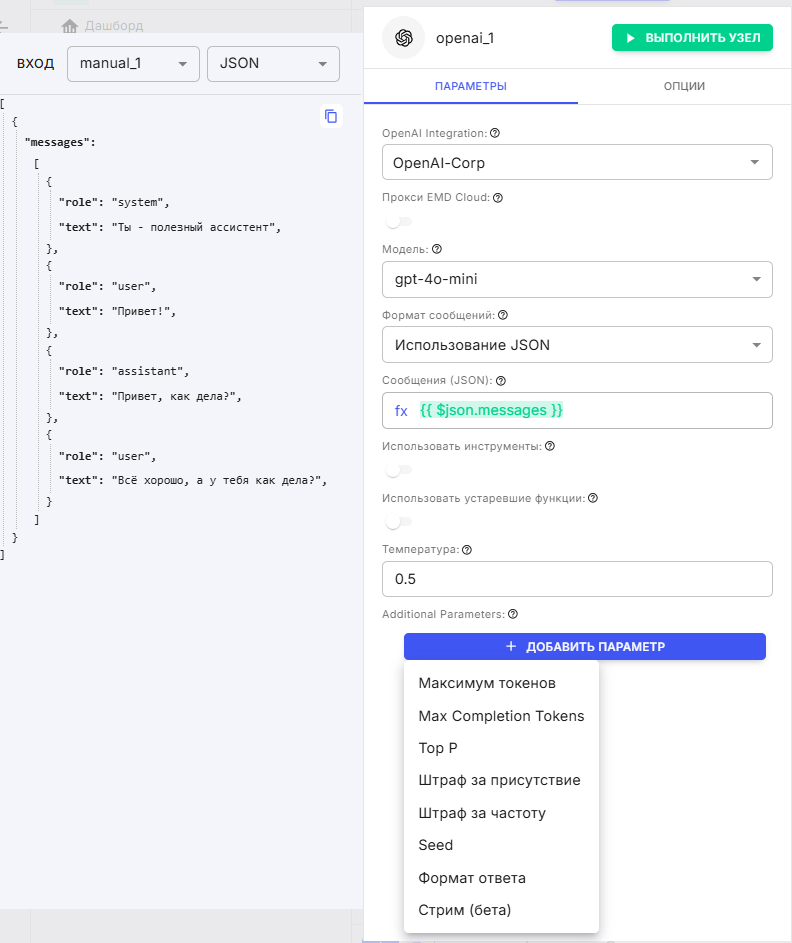

Настройка

| Параметр | Описание |

|---|---|

| OpenAI Integration | Выбор настроенной интеграции OpenAI |

| Прокси EMD Cloud | Маршрутизировать запрос через прокси EMD Cloud |

| Модель | Модель OpenAI для генерации (например gpt-4o-mini) |

| Формат сообщений | Способ передачи сообщений в запросе |

| Использовать инструменты | Включить поддержку tool calling |

| Использовать устаревшие функции | Включить поддержку устаревшего function calling |

| Температура | Случайность ответа: 0 — детерминированный, 2 — максимально случайный |

Формат сообщений: Использование JSON

Передаёт массив сообщений из поля воркфлоу через выражение, например {{ $json.messages }}.

Ожидаемый формат массива:

[

{ "role": "system", "text": "Ты - полезный ассистент" },

{ "role": "user", "text": "Привет!" },

{ "role": "assistant", "text": "Привет, как дела?" }

]

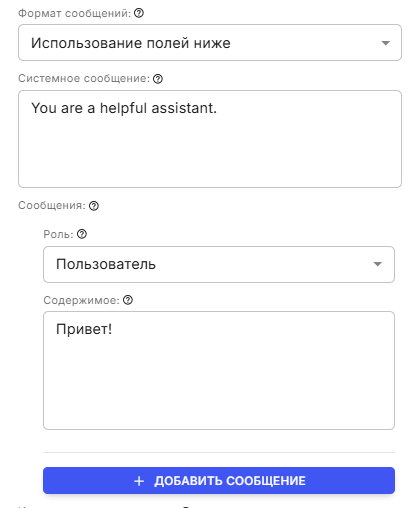

Формат сообщений: Использование полей ниже

| Параметр | Описание |

|---|---|

| Системное сообщение | Системный промпт — задаёт поведение и контекст модели |

| Роль | Роль сообщения: Пользователь или Ассистент |

| Содержимое | Текст сообщения |

Кнопка + ДОБАВИТЬ СООБЩЕНИЕ добавляет следующее сообщение в диалог.

Additional Parameters

Дополнительные параметры генерации, добавляются по необходимости:

| Параметр | Описание |

|---|---|

| Максимум токенов | Общий лимит токенов |

| Max Completion Tokens | Лимит токенов только в ответе |

| Top P | Nucleus sampling — альтернатива температуре |

| Штраф за присутствие | Штраф за использование уже упомянутых тем |

| Штраф за частоту | Штраф за повторяющиеся токены |

| Seed | Фиксированное зерно для воспроизводимых результатов |

| Формат ответа | Формат вывода (например JSON) |

| Стрим (бета) | Потоковая передача ответа |

Выходные данные

Нода возвращает ответ модели в поле message.content, а также метаданные: использованные токены, идентификатор запроса и другие поля ответа API OpenAI.